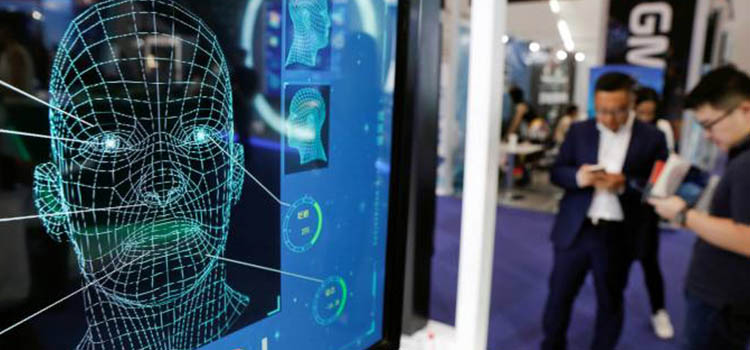

Um time de pesquisadores da empresa de cibersegurança McAfee conseguiu enganar um sistema moderno de reconhecimento facial. Os especialistas divulgaram uma pesquisa que apresenta a ideia por trás da tecnologia, que modifica a interpretação do algoritmo, fazendo-o pensar que uma pessoa na realidade é outra.

A divulgação do resultado das pesquisas é feita para alertar sobre o uso de sistemas de reconhecimento facial, que têm ganhado espaço e mercado, e já são comumente implementados em aeroportos para a verificação de passaportes, por exemplo.

O algoritmo funciona com base em uma tecnologia chamada CycleGAN, que faz alterações em imagens digitais — é possível transformar um cavalo em uma zebra, uma paisagem de verão em uma de inverno, ou uma fotografia de um rio em um quadro do pintor francês Claude Monet.

O treino dessa tecnologia foi feito com a inclusão de 1.500 imagens dos próprios pesquisadores, com a inclusão de diferentes expressões e gestos. Depois de gerar centenas de imagens, o CycleGAN eventualmente conseguiu criar uma imagem que era interpretada a olho nu como sendo um dos pesquisadores, mas que era lida como sendo o outro pesquisador pelo sistema de reconhecimento facial.

Embora o estudo levante questionamentos sobre a segurança dos sistemas de biometria facial, há alguns problemas. O primeiro deles é que o teste não foi realizado com um sistema que está em funcionamento em aeroportos, por exemplo, apesar de os pesquisadores terem levantado essa temática. Foi utilizado um sistema de código-aberto e os pesquisadores, no entanto, acreditam que, com a alta similariedade dos algoritmos de reconhecimento facial, é possível que esse tipo de ataque funcione em diversos sistemas. Além disso, um ataque desse tipo requeriria alta capacidade de processamento, com investimento em tempo e computadores.

Em entrevista à revista MIT Technology Review, os pesquisadores afirmaram que o objetivo é demonstrar as vulnerabilidades desse tipo de inteligência artificial e deixar claro que seres humanos devem fazer parte de um processo de segurança mais robusto. “Se substituir cegamente um sistema existente que depende de humanos sem ter algum tipo de checagem secundária, você pode estar introduzindo uma fraqueza maior do que a que existia antes”, disse Steve Povolny, um dos autores da pesquisa, à revista.

Sistemas de reconhecimento facial têm sido tema de debate nos últimos anos: embora facilitem processos para empresas e governos, levantam preocupações de movimentos preocupados com privacidade e garantias civis — para muitos a possibilidade de falsos positivos (quando alguém é falsamente reconhecido por biometria) é um tema que demanda maior discussão. No final do ano passado, um estudo do governo dos Estados Unidos, realizado pelo Instituto Nacional de Padrões e Tecnologia (NIST, na sigla em inglês), revelou que algoritmos têm uma taxa 100 vezes maior de resultados incorretos na identificação de pessoas negras e asiáticas.

Neste ano, a gigante IBM anunciou que encerraria sua área de pesquisa em biometria facial e a varejista Amazon, que também desenvolve a tecnologia, afirmou que não iria mais negociar seus sistemas com forças policiais.