O CEO da IBM, Arvind Krishna, enviou uma carta ao senado dos Estados Unidos lamentando as mortes de George Floyd, Ahmaud Arbery, Breonna Taylor e outros negros assassinados alegando que “a luta contra o racismo é mais urgente do que nunca”.

Krishna ainda se prontificou a ajudar o congresso na busca por justiça e equidade racial, e sugeriu “políticas para tecnologias responsáveis” como uma medida para promover a causa. Sua definição de “responsável” é que a tecnologia não deve promover discriminação ou injustiça racial.

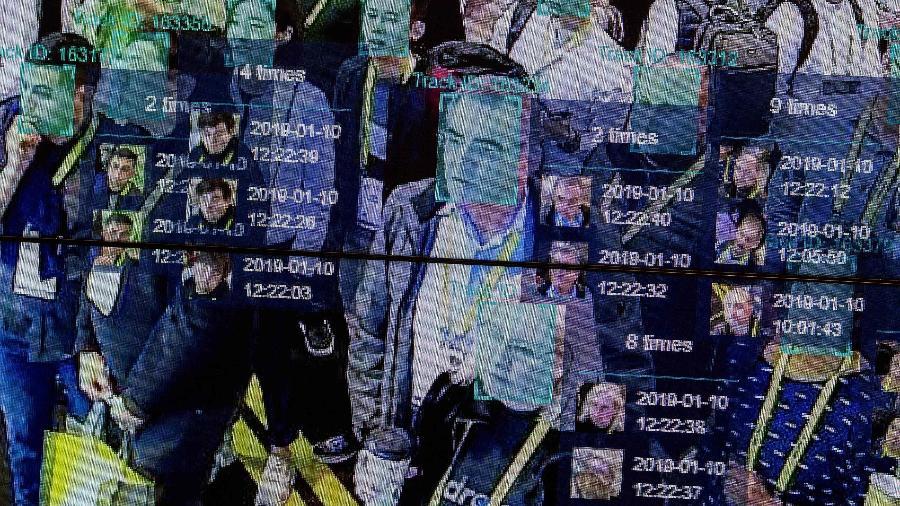

Com o posicionamento, a companhia precisou mudar suas estratégias e anunciou que irá desistir de seu software de reconhecimento e análise facial.

“A IBM se opõe firmemente e não vai tolerar o uso de nenhuma tecnologia, incluindo as soluções de reconhecimento facial oferecida por outros fornecedores, para vigilância em massa, perfis raciais, violação dos direitos e liberdades humanos básicos ou qualquer outra finalidade que não seja consistente com nossos valores e princípios de confiança e transparência”, informou o presidente na carta.

O CEO ainda completou: “acreditamos que agora é a hora de iniciar um diálogo nacional sobre como e se a tecnologia de reconhecimento facial deve ser empregada pela polícia.”

Ele também disse que a Inteligência Artificial é uma poderosa ferramenta que pode ajudar na aplicação da lei para deixar os cidadãos a salvo, mas fornecedores e usuários têm a responsabilidade conjunta de garantir que os sistemas de IA sejam testados e auditados.

Krishna também convocou a reforma da polícia, e a criação de um banco de dados para registrar má conduta policial, além de recomendar que o congresso desenvolva programas que ajudem negros a terem mais acesso à educação e que, por consequência, preencham mais vagas no mundo da tecnologia. Ele deu como exemplo duas iniciativas da IBM.

Apesar da postura atual de anti-vigilância da IBM é importante lembrar que no passado a tecnologia de reconhecimento facial da companhia foi classificada como a pior em um teste com três outras soluções. O The Register relatou no início de 2018 que os resultados dos testes demonstraram que o sistema da companhia teve dificuldades com tons de peles mais escuros. As taxas de erro foram de 0,3% para homens brancos, 7,1% para mulheres brancas, 12% para homens negros e 34,7% para mulheres negras.