Ainda que longe das representações pós-apocalípticas do cinema, o avanço da inteligência artificial (IA) no nosso cotidiano, seja na forma de algoritmos das redes sociais ou nos assistentes virtuais como Alexa e Siri, tem gerado preocupação em várias esferas da sociedade. Nomes como Elon Musk, Steve Wozniak, Bill Gates e Stephen Hawking já se manifestaram sobre os riscos gerados pela IA, apoiados por pesquisadores da área. Se tratando de um avanço tecnológico tão almejado no meio científico, o que estaria por trás dessa preocupação?

Certamente não é o caso de se imaginar algo como o personagem do Exterminador do Futuro, vivido pelo ator Arnold Schwarzenegger, que busca a extinção da raça humana. Os receios iniciais são problemas mais palpáveis, como a coleta massiva de dados da população e sua subsequente utilização.

Empresas como Google, Amazon e Facebook, por exemplo, não poupam esforços na guerra por informação, dominando sistemas de buscas e conteúdo audiovisual, além de mensagens eletrônicas, em todas as partes do mundo.

“Essa monopolização dos dados significa uma monopolização da capacidade de monetizá-los e gerar novos avanços tecnológicos com base neles. A disputa pelos lados é uma disputa central e parte considerável destes serviços está fazendo pelo mundo todo”, analisou o professor de sociologia econômica da Universidade Federal do Ceará Edemilson Paraná.

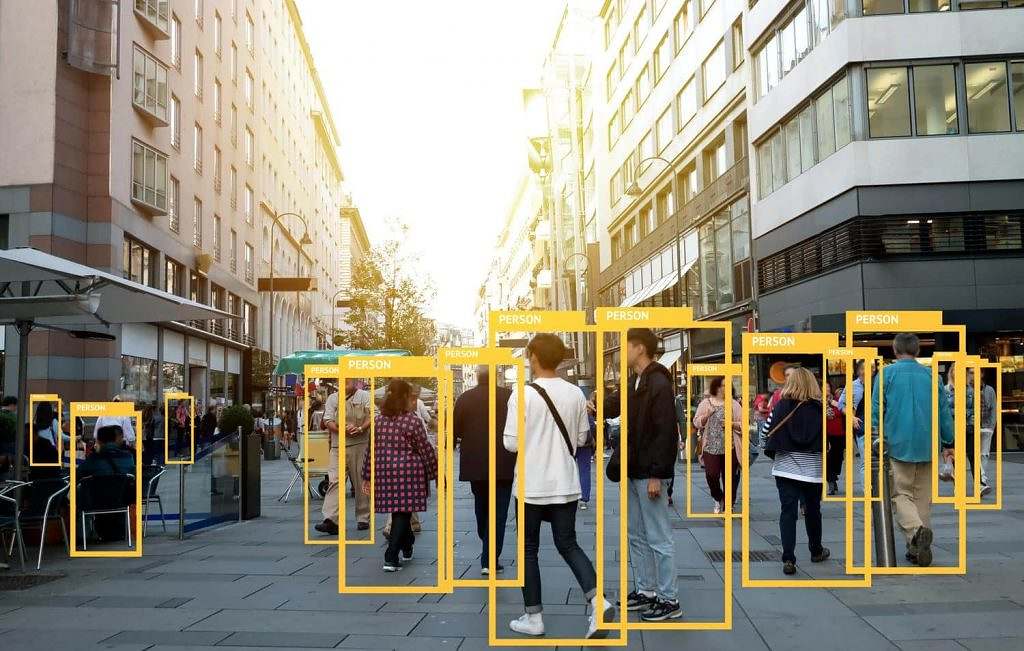

Ao passo que há leis pelo mundo que dão proteção à privacidade e uso de dados do usuário, como a GDPR, na Europa, e a recém-sancionada Lei Geral de Proteção de Dados, no Brasil, vemos a popularização de sistemas de reconhecimento facial, monitorando e controlando cidadãos. Na China, protestos contra leis de extradição ficaram famosos por discutir a vigilância massiva e efeitos do reconhecimento facial em toda população.

Outro ponto que tem suscitado o debate sobre a falta de limites da IA, é a questão de erros na elaboração de perfis criminais. Durante uma reunião pública em junho deste ano, o chefe de polícia de Detroit chegou a admitir que a tecnologia de reconhecimento facial usada pela polícia da cidade “quase nunca” traz uma correspondência exata com a imagem do suspeito, e “quase sempre” identifica incorretamente as pessoas. No Rio de Janeiro, uma mulher foi detida equivocadamente em julho de 2019 acusada de ser uma foragida da Justiça, condenada por espancar um homem até a morte.

Esses equívocos são ainda mais representativos quando se inclui a questão racial. Um teste realizado em 2018 por pesquisadores do Instituto de Tecnologia de Massachusetts (MIT) e da Universidade de Stanford mostrou que sistemas de reconhecimento facial apresentam uma margem pequena de erro no caso de homens brancos (0,8%), mas considerável em situações que envolvem mulheres negras (de 20% a 34%). Os falsos positivos, de maneira idêntica, também apresentam discrepâncias, sendo de dez a cem vezes maior para negros e asiáticos se comparado aos brancos, conforme estudo do governo dos Estados Unidos feito em 2019.

Superinteligência, armas autônomas e segurança

Enquanto a ideia de um exterminador do futuro pode parecer exagerada, um outro conceito deste mesmo universo é bem mais plausível: a superinteligência, também conhecida como IA Forte, capaz de superar humanos em praticamente todas as tarefas cognitivas.

Caso alcançada, uma tecnologia como esta poderia se auto-aperfeiçoar constantemente, ultrapassando o intelecto humano. E com o controle de outras IAs, presentes em carros, aeronaves, fintechs e até mesmo equipamentos como marcapassos, é imprescindível alinhar os objetivos desta superinteligência aos nossos, especificamente antes que ela se torne “super”.

Apesar do conceito poder demorar décadas, séculos, já que ainda há muita divergência entre experts e teóricos, uma realidade tangível e que tem ganhado força e investimentos são as armas autônomas. Drones e tanques inteligentes, descritos como a terceira revolução das guerras, depois da pólvora e das armas nucleares, são desenvolvidos por vários países, entre eles Estados Unidos, Rússia e China.

Argumenta-se que eles podem diminuir o número de mortes por substituírem seres humanos, entretanto, ao serem programados para atingir um objetivo pré-definido a qualquer custo, surge uma preocupação ainda maior: qual será o valor dado às vidas inocentes.

Como diminuir os riscos?

Em 2017, pesquisadores se reuniram na Califórnia para debater medidas de redução e controle de riscos. Desta conferência resultou um documento Princípios de Asilomar, que lista importantes pontos a serem considerados no avanço da inteligência artificial, como segurança, privacidade e respeito aos valores e direitos humanos, por exemplo. Empresas também têm criado suas próprias diretrizes. Microsoft e Google, por exemplo, enumeraram critérios como transparência, imparcialidade, inclusão e benefício social entre seus princípios.

A Comissão Europeia, por sua vez, reforça que a IA deve ser centrada nas pessoas, promovendo direitos, e com participação e controle dos seres humanos, respeitando, desta forma, diversidades como gênero, raça e orientação sexual. Igualmente, a transparência é um ponto-chave, com ênfase na garantia de rastreabilidade e explicabilidade, assegurando o direito à privacidade e ao controle do indivíduo sobre seus dados.

Fonte: Agência Brasil e Future of Life Institute